Microsoft Fabric – „All-in-One“- Plattform für Datenanalyse

Mit Microsoft Fabric erhalten Sie alle Funktionen, um Ihre Daten zentral bereitzustellen, präzise zu modellieren, anschaulich zu visualisieren und datenbasierte Prozesse auszulösen. So verbessern Sie Ihre Entscheidungsfindung und optimieren Ihre Geschäftsprozesse nachhaltig. Dank der hochskalierbaren „Software-as-a-Service“-Lösung passt sich Fabric flexibel an Unternehmen jeder Größe an.

Was ist Microsoft Fabric?

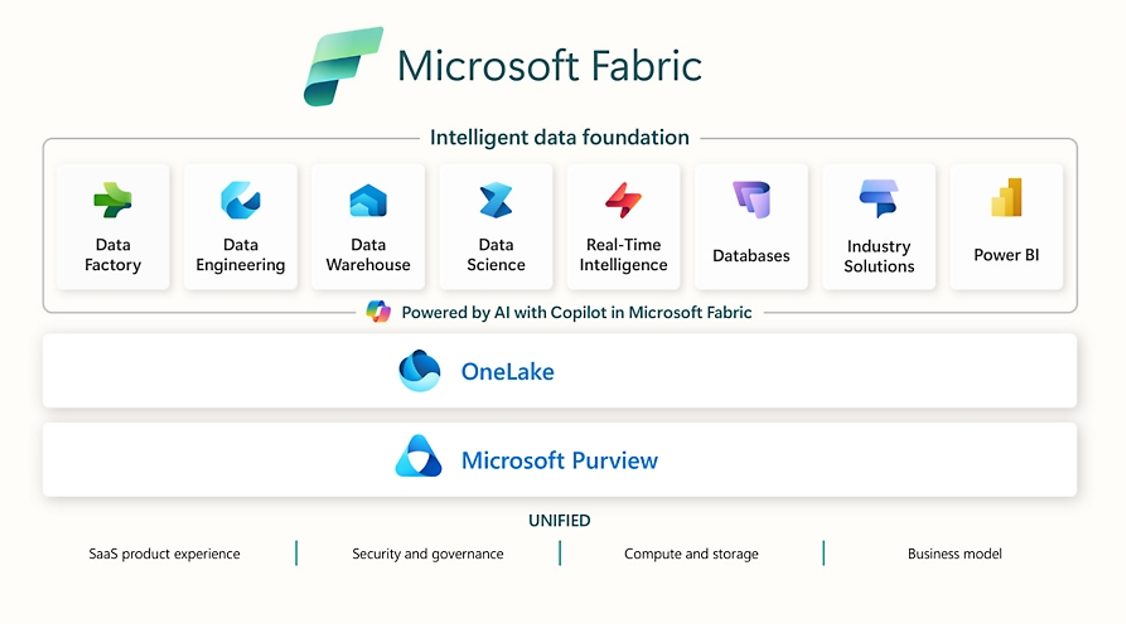

Microsoft Fabric ist eine „Software-as-a-Service (SaaS)“-Lösung mit der Unternehmen Ihre Daten vereinheitlicht und abgesichert zur Analyse bereitstellen. Die Daten werden aus beliebigen Datenquellen zentral zusammengestellt und zur Auswertung optimal vorbereitet oder in Echtzeit an Visualisierungen ausgeliefert. Die Daten werden mit Power BI dargestellt oder mittels Machine-Learning-Verfahren untersucht. Überschrittene Schwellwerte lösen automatisierte Prozesse aus. Fabric eignet sich sowohl für relationale Daten als auch für die Analyse unstrukturierter Informationen. Der Einsatzbereich erstreckt sich von kleinen Datenmengen bis hin zu Big-Data-Szenarien. Microsoft Fabric umfasst die folgenden Komponenten:

Anwendungsbeispiele: Wie Microsoft Fabric Prozesse optimiert und fundierte Entscheidungen ermöglicht

Microsoft Fabric besteht aus einer beeindruckenden Reihe von Werkzeugen für Data Analytics, Business Intelligence und Künstliche Intelligenz. In den folgenden Anwendungsbeispielen stellen wir Ihnen vor, welche Lösungen mit diesen Werkzeugen erstellt werden können. Die Expertise der datenkultur liegt im Besonderen in der Wirtschaftsinformatik. Daher haben wir Szenarien aus dem Vertrieb, dem Finanzcontrolling und der Planung gewählt. Microsoft Fabric eignet sich aber auch hervorragend für ganz andere Anwendungsbereiche wie technische oder medizinische Lösungen.

KI: Lead-Scoring durch künstliche Intelligenz

Mit Microsoft Fabric und KI-gestütztem Lead-Scoring investieren Vertriebsmitarbeiter ihre Zeit in die aussichtsreichsten Leads. Durch die intelligente Analyse von Kampagnen-, CRM- und ERP-Daten werden Muster erkannt, die den Erfolg eines Leads vorhersagen. So lassen sich Vertriebschancen frühzeitig bewerten, Prioritäten klar setzen und die Abschlussrate nachhaltig steigern – für eine datengetriebene und effiziente Vertriebsstrategie.

Big Data: Internationales Finanzcontrolling

Im Finanzcontrolling international tätiger Unternehmen werden Daten aus Niederlassungen, Tochterunternehmen und verschiedenen ERP-Systemen zentral zusammengeführt. Microsoft Fabric harmonisiert Buchungen, abweichende Kontenpläne und Konsolidierungswerte – selbst bei komplexen Berechtigungen. So erhalten Verantwortliche transparente, visualisierte Einblicke für fundierte strategische Entscheidungen.

Planung: Detaillierte Umsatzplanung mit KI-Prognosen

Mit Microsoft Fabric wird die detaillierte Umsatzplanung effizient und wesentlich schneller: Das Controlling profitiert von einer Lösung, die historische Buchungsdaten, aktuelle Angebote und Aufträge kombiniert, um präzise KI-Prognosen zu erstellen. Die intuitive Erfassung von Planzahlen auf Artikel- und Kundenebene, automatisierte Gruppenzuweisungen und transparente Freigabeprozesse optimieren den gesamten Planungsprozess – für fundierte und zukunftssichere Entscheidungen.

Wie wird Fabric lizenziert?

Microsoft Fabric wird als Azure-Produkt bereitgestellt. Das Lizenzmodell von Microsoft Fabric besteht aus drei Komponenten.

Rechenleistung – Kapazitätseinheit (CU)

Einer Fabric-Kapazität wird mit dem Lizenzerwerb eine feste Menge an Rechenleistung zugeordnet. Die ausgeführten Aktionen teilen sich die erworbene Leistung.

Speicherplatz - OneLake

Die Kosten für Speicherplatz sind abhängig von der genutzten Menge. Data Lake Storage ist mit etwa 25 EUR* pro Terrabyte und Monat vergleichsweise preiswert.

Regionsübergreifender Datentransfer

Datenübertragungen von einer Azure Region in eine andere Region sind kostenpflichtig. Die Kosten liegen je nach Regionen zwischen 20 EUR* und 150 EUR* pro Terrabyte und Monat.

Weitere Informationen zur Lizenzierung finden Sie auf unserer Preisseite. *Die angegebenen Preise für Fabric sind unverbindlich und entsprechen dem Stand vom 04.05.2026. Sie verstehen sich zzgl. gesetzlicher Mehrwertsteuer. Für ein konkretes Angebot vereinbaren Sie bitte eine professionelle Lizenzberatung.

Welche Dienstleistungen bieten wir Ihnen an?

Unsere Dienstleistungen umfassen die vollständige Betreuung Ihres Microsoft-Fabric-Projektes. Unser erfahrenes Team unterstützt Sie in allen Phasen des Projekts. Egal, ob Sie von Anfang an eine Rundumbetreuung wünschen oder nur Hilfe bei bestimmten Modulen benötigen. Wir passen unsere Unterstützung an Ihre individuellen Anforderungen an. Unsere Experten begleiten Sie durch die wesentlichen Projektschritte, um sicherzustellen, dass Ihr Business-Intelligence-Projekt erfolgreich umgesetzt wird.

Design

Ein Datenprojekt löst definierte Fragen. Wir helfen Ihnen die richtigen Fragen zu finden und eindeutig zu formulieren. Was ist das Ergebnis einer Analyse? Wie muss ich auf die Ergebnisse reagieren? Wie wird das Ergebnis der Analysen dargestellt?

Scoping

Welche Fabric-Komponenten sind für mein Projekt geeignet? Welche Produktversion ist die passende für unsere Anforderungen? Welche Skills prägen wir selbst aus? Welcher Mitarbeiter wird für welche Aufgabe ausgebildet? Welche Leistungen kaufen wir von Spezialisten ein?

Einrichtung

Wir helfen bei der Einrichtung und Konfiguration von Microsoft Fabric. Wir definieren Ihre Anforderungen an Zugriffsberechtigungen und entwickeln geeignete Konzepte, um diese langfristig sicherzustellen. Wir integrieren Ihre Microsoft-Fabric-Kapazität in Ihre IT-Umgebung.

Schulungen

Jede Komponente von Microsoft Fabric ist eine komplexe Anwendung und bedarf separater Schulungen. Was leistet die jeweilige Fabric Komponente? Welche Werkzeuge und Programmiersprachen gibt es? Wie wende ich die diese an?

Entwicklung

Unsere Fachleute und Spezialisten erstellen die Lösung für Sie. Wir leiten aus Ihren Anforderungen einen geeigneten Projektplan ab und realisieren die Anwendung für Sie. Wie werden die Daten bereitgestellt? Wie werden die Daten optimiert? Wie werden die Daten visualisiert?

Coaching

Unsere Fachleute begleiten Ihr Team bei der Realisierung Ihres Projektes. Wir helfen bei der Konzeption, beim Projektmanagement und bei der Realisierung. Wir vermitteln Best-Practices und helfen bei der Einhaltung dieser.

Microsoft Fabric – jetzt direkt hier informieren!

Sie möchten mehr über Fabric erfahren? Gerne stellen wir Ihnen die Funktionen und Vorteile von Microsoft Fabric in einer unverbindlichen, kostenlosen Online-Präsentation vor. Vereinbaren Sie hier einen Termin:

Microsoft Fabric – jetzt direkt hier informieren!

Sie möchten mehr über Fabric erfahren? Gerne stellen wir Ihnen die Funktionen und Vorteile von Microsoft Fabric in einer unverbindlichen, kostenlosen Online-Präsentation vor. Vereinbaren Sie hier einen Termin:

Weiterführende YouTube-Videos rund um Microsoft Fabric

Mit diesem kurzen Überblick startet unser Geschäftsführer Andreas Koblischke eine neue Video-Reihe, die sich intensiv mit dem Tool von Microsoft auseinandersetzt.

Im zweiten Teil der Videoreihe zeigt Andreas Koblischke einige praxisnahe Beispiele für den Einsatz von Microsoft Fabric auf.

Der dritte Teil der Videoreihe ist ein kurzer Deep Dive in die Technik von Fabric. Durch viele Beispiele werden die einzelnen Komponenten anschaulich erklärt.

Häufig gestellte Fragen (FAQ)

Ist Power BI in Microsoft Fabric enthalten?

Ab einer Kapazität mit 64 Kapazitätseinheiten (F64) ist das Ausführen von Power-BI-Berichten für beliebig viele Anwender enthalten. Für Fabric-Instanzen mit weniger Kapaziätseinheiten wird dafür eine separate Power-BI-Lizenz pro Benutzer benötigt. Für das Erstellen von Power-BI-Dashboards ist generell mindestens eine Power-Pro-Lizenz erforderlich.

Wie bestimme ich, wie viel Rechenleistung (CU) für mein Projekt benötigt wird?

Je nach Datenmenge, erforderlicher Fabric-Dienste, nötiger Verarbeitungsgeschwindigkeit und Benutzeranzahl ist die benötigte Leistung sehr unterschiedlich. Datenprojekte wachsen mit der Zeit. Wir empfehlen, sich von unten heranzutasten und erst bei Bedarf mehr Leistung zu erwerben. Für eine gute Indikation empfehlen wir bei größeren Projekten einen Belastungstest als Proof-of-Concept mit Demo-Daten zur Ermittlung aufzusetzen.

Kann ich Fabric mit Apple Computern verwenden?

Microsoft Fabric ist eine SaaS (Software-as-a-Service)-Anwendung und wird im Web-Browser betrieben. Es ist damit mit jedem Betriebssystem wie beispielsweise Windows, Linux oder MacOS kompatibel. Einige Anwendungen wie z.B. Power BI haben zusätzlich Windows-Desktop-Anwendungen, die nur auf Windows-Computern installiert werden können. Die Funktionen stehen aber meistens auch in der Web-Anwendung zur Verfügung. Microsoft ist sehr aktiv dabei, alle Funktionen als SaaS-Lösung bereitzustellen.